从人才争夺到生产力落地:深度解析 AI 如何重塑企业软件与 DevOps 疆界

overloaded AI 的 AI API 使用建议

overloaded AI 面向需要 OpenAI 兼容接口、Claude/Gemini/GPT 多模型切换、包月额度管理和图像模型调用的用户。阅读本文后,可以结合本站的模型清单、独立使用文档和个人面板,把教程内容直接落到实际调用流程中。

在当今的科技版图中,人工智能(AI)正以前所未有的速度改写着游戏规则。从资本市场到人才市场,再到具体的软件交付流水线,一场深刻的变革正在发生。近日,顶级软件公司高管纷纷“投奔”OpenAI 的新闻再次为行业敲响了警钟:AI 不仅仅是一个工具,它正在成为企业生存的分水岭。

一、 人才保卫战:传统软件巨头的焦虑

根据 CNBC 的最新报道,由于担心 AI 带来的颠覆性影响,传统软件巨头的股价正经历多年来的最差表现。更令这些公司雪上加霜的是一场激烈的“人才战争”。包括 Salesforce、SAP 等传统软件巨头的高管正在纷纷“跳船”,转而加入 OpenAI 等 AI 领军企业。

这种人才流向的转变反映了行业深处的恐慌:当 AI 能够自动生成代码、自动化业务流程甚至重新定义人机交互时,传统的企业级软件模式是否还有未来?然而,在人才奔向 AI 的同时,企业内部的 AI 落地情况却呈现出一种奇特的“二元化”现象。

二、 冰火两重天:为什么 AI 在 CI/CD 中进展缓慢?

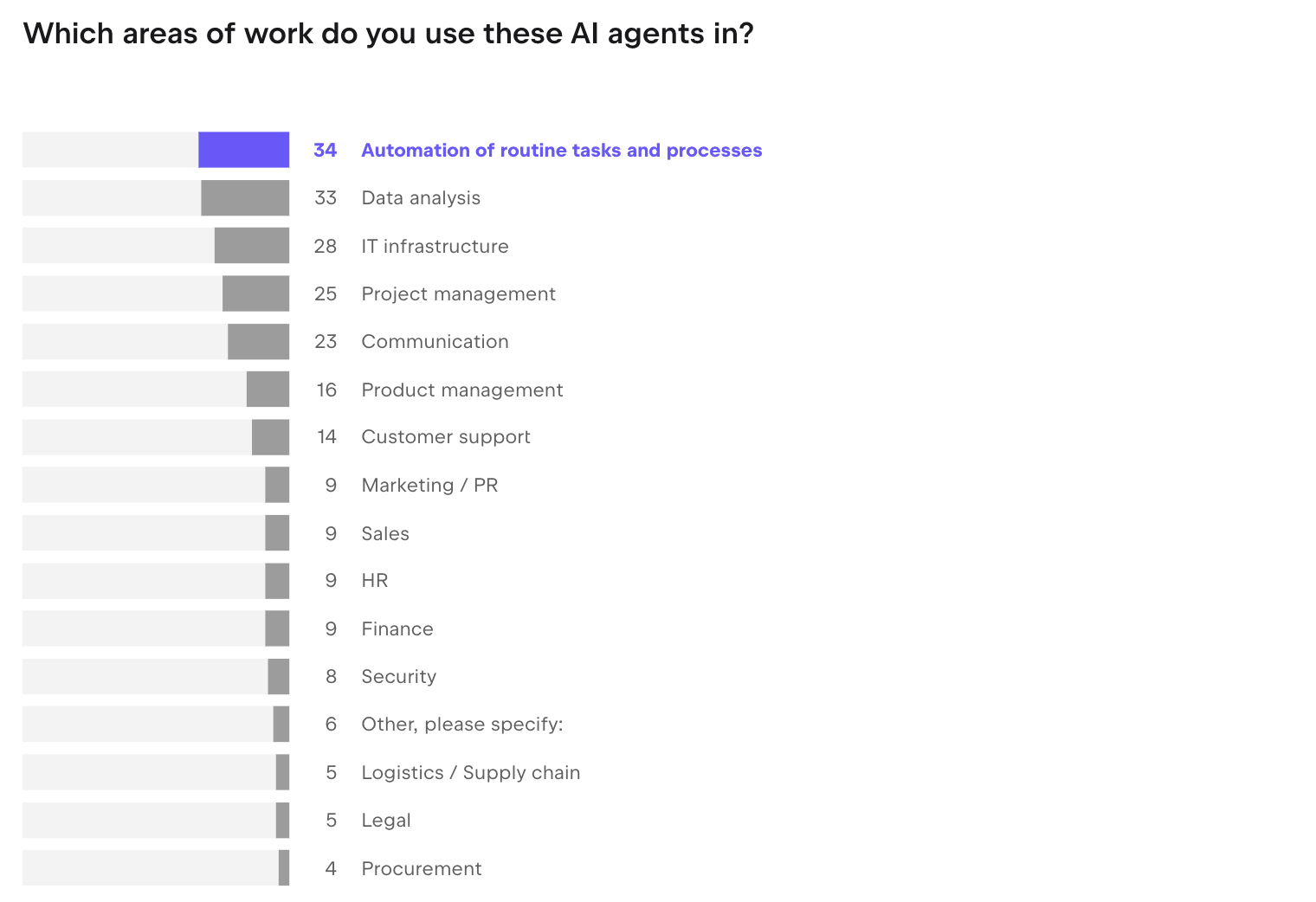

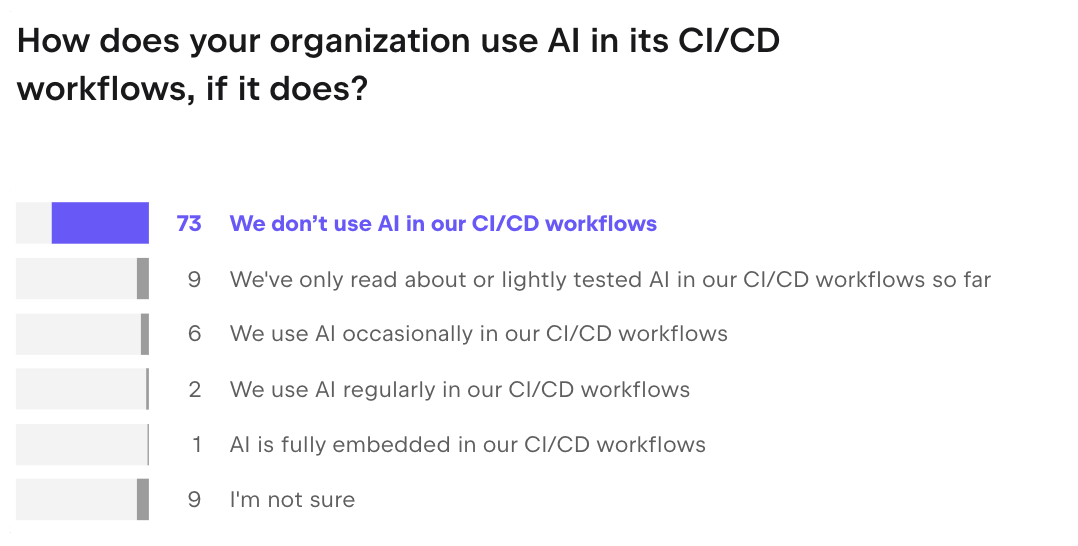

根据 JetBrains 最近发布的《AI Pulse》调研报告,AI 在软件开发生命周期中的应用极度不平衡。虽然超过 90% 的开发者已经开始在日常工作(如编写代码、调试和文档编写)中使用 AI,但在 CI/CD(持续集成与持续交付)流水线中,AI 的采用率却低得惊人。

现状:开发端爆火,交付端遇冷

调研数据显示:

- 73% 的组织根本没有在 CI/CD 流水线中使用 AI。

- 60% 的团队表示不清楚 AI 在交付端的具体使用场景或价值。

- 36% 的人对 AI 生成的结果缺乏信任。

- 33% 的人担心数据隐私问题。

根本原因:确定性 vs. 非确定性

这种巨大的鸿沟源于开发环境与交付环境在“容错率”上的本质差异。CI/CD 系统被设计为一种“证据系统”,其核心任务是提供稳定的、可重复的信号,以验证代码是否可以安全发布。而目前的生成式 AI 本质上是非确定性的,这种特性与追求极致稳定性的流水线产生了天然的张力。

三、 AI 在 DevOps 中的真实落脚点

尽管大规模采用尚需时日,但在一些特定领域,AI 已经开始展示出其作为“加速器”的威力。这些成功的用例有一个共同点:AI 辅助验证,而非取代验证。

1. 故障诊断与日志分析

这是目前 AI 在 DevOps 中最卓有成效的应用。当构建失败时,AI 可以快速扫描数千行日志,识别重复出现的错误模式,并将其与之前的运行记录进行关联,从而大幅缩短开发者的排查时间。

2. 安全修复与漏洞补丁

在安全工作流中,AI 不再仅仅是发现漏洞,它开始尝试解释漏洞成因并提出修复补丁。这些建议随后会经过标准的 CI/CD 验证(如自动化测试和人工审核),确保安全提升的同时不会引入回归缺陷。

3. 测试优化

测试通常是流水线中最耗时的部分。AI 可以通过分析历史运行数据和代码变更,识别出最相关的测试子集,实现“精准测试”,从而在不牺牲覆盖率的前提下加快反馈周期。

四、 从“副驾驶”到“智能体”:未来的成熟度模型

AI 在 DevOps 中的演进并非一蹴而就,我们可以将其分为四个阶段:

- 无 AI 阶段:流水线完全由人工和脚本驱动,对所有变更一视同仁。

- 辅助理解阶段:AI 帮助解释失败原因和日志,辅助人类做决策。

- 辅助建议阶段:AI 主动建议修复方案、生成拉取请求(PR)或优化配置,但仍需人类审核。

- 智能体化阶段(Agentic Workflows):AI 可以在受控范围内触发行动,如自动重新运行流水线、根据反馈调整资源分配。这一阶段需要极高的治理水平和权限控制。

五、 结论:构建 AI 时代的“信任层”

随着 AI 生成的代码量激增,CI/CD 系统非但不会过时,反而变得更加重要。它是防范“AI 幻觉”进入生产环境的最后一道防线。未来的 DevOps 平台将从纯粹的自动化工具转变为一个复杂的治理框架,负责对 AI 生成的内容进行过滤、约束和审计。

企业在追求 AI 生产力的同时,必须自问:当流水线每天需要处理数百个 AI 生成的变更时,我们的治理机制能否跟上?我们如何定义“有意义的人工干预”?

AI 正在加速一切,而 CI/CD 的任务是确保这种加速度不会导致“翻车”。在这场 AI 转型中,谁能率先构建起可靠的 AI 信任层,谁就能在人才与市场的双重竞争中赢得未来。